TL;DR: 為大家介紹和分析一個即將成為未來一年研究熱點的 sub-topic: Personalized Dialog System!有強烈發 paper 的小夥伴們註意啦,上面這句話對你們來說翻譯過來就是:這就是 19 年最有可能 get paper accepted 的任務之一咯!

作者丨駱梁宸

學校丨北京大學本科在讀

研究方向丨Dialogue/NLP/ML Theory

個人主頁丨https://www.luolc.com/

NLP的四個Open Problems & 對話系統的重要性

相信很多 NLP 研究者都已經拜讀過由 Sebastian Ruder 在 Deep Learning Indaba 2018 上的 talk 整理而來的文章:The 4 Biggest Open Problems in NLP。

http://ruder.io/4-biggest-open-problems-in-nlp/

這篇含金量十足的文章來自於對包括 Yoshua Bengio 在內的 20 餘位領域內頂級研究者的訪談整理而來。

四個 open problems 中排名第一的是 Natural Language Understanding(自然語言理解)問題,解決它是許多 NLP tasks 能否順利實現的先決條件。與此同時,非常多的研究人員同時提到 Dialogue System(對話系統),特別是 Goal-Oriented(任務型)Dialogue System 也是一個非常重要的 open problem,或者說,是檢驗 NLU 問題是否可解的一種終極方式。

從大約 2016、2017 年起,針對 Dialogue System 的研究逐漸從鮮有人問津到逐漸引起 NLP 社群內的重視。在剛剛過去的一年裡,相關工作的數量增長迅猛,顯示出其成為 NLP 領域內新一 (hǎo) 熱 (guàn) 點 (shuǐ) 方向的潛質。

而另一方面,隨著發展初期透過將 Neural Machine Translation 中的方法直接換湯不換藥的遷移到 Dialogue 的快速灌水階段逐漸結束,如今再想要在這一 track 下發表文章已經不能再像從前那樣簡單粗暴,而必須要想辦法聚焦到 Dialogue 中更加核心、更加有價值的點。

在上文提到的訪談中 Kevin Gimpel 提到:

We should develop systems that read and understand text the way a person does, by forming a representation of the world of the text, with the agents, objects, settings, and the relationships, goals, desires, and beliefs of the agents, and everything else that humans create to understand a piece of text. Until we can do that, all of our progress is in improving our systems’ ability to do pattern matching.

從這段話其實也能推斷出 Dialogue 任務為什麼被認為“非常困難”。以 NMT 作為對比,我們可以發現在大部分情形下,除非涉及很高的文學技巧或極深的歷史背景,通常而言 NMT 只需要聚焦在所翻譯的文字本身即可,幾乎沒有任何外沿 —— 一個好的翻譯系統,其實就是要穩定準確且還原本意即可。

而對話則大有不同,想象人類對話的場景,決定我們如何產生或回覆一句話的因素來自方方面面:對話的場合、談話的目的、雙 (多) 方的身份和心理與情緒狀態等。這些通通隱藏在一句句對白的背後,是同樣需要 forming 的 representation. 我們需要設法構造更加智慧化的系統以關註到這些問題。

其中最為重要,也即將成為未來一段時間熱點之一的,是 Dialogue System 的個性化問題。

Personalization in Dialogue System

對話的一個顯著特點,同時也是與其他 NLP 場景如翻譯、摘要和閱讀理解等最大的不同,是談話者具有的身份特徵。很容易理解,一句話的風格隨著其說出者的不同可以有極大變化;此外,在人們日常交流中,根據對方的身份和偏好靈活調整談話的內容、風格和策略是非常自然的行為——而這些在 conventional dialogue model 中完全無法得以體現。

在以 Jiwei Li 的工作 [1] 為代表的早期研究中,研究者們對個性化問題的前一部分,即為 chatbot 賦予特定人格進行了一定探索。但這一類工作的實用性是有明顯限制的——我們更加期望 Agent 能夠根據我們每個人的自身特點對我們進行個性化服務,而並不在意麵對的 Agent 是性格溫和、暴躁、還是傲嬌的——實際上這類模型最具前景的實用化方向大概就是遊戲 NPC 構建了。

而個性化中意義更大的另一方面,即設法讓 Agent 可以感知使用者身份和偏好並以此提供個性化的對話,難度要大很多。這主要是受限於資料集的缺失——我們長期缺少額外標註有對話者的資訊的資料集。

而上段提到的賦予人格,其實非常類似於 language style transfer/assignment 任務,並不過多受限於 Dialogue 的形式,因而可以透過其他型別的帶身份標註的語料進行補充。而針對對方身份進行個性化,則是無論如何無法繞過帶身份資訊的 dialogue dataset 的。

而我們之所以能推測個性化對話系統很快將成為研究熱點,便是因為資料集這一關鍵問題已經被解決了。

做 Dialogue System 的同學一定都知道 FAIR 的一個組:Team PerlAI。其不僅產出了 NLP 領域近十年來最重要的成果之一 Memory Network,更重要的是在近年持續的釋出新鮮高質量的對話資料集。

在 2018 年初他們新 release 了名為 Persona-Chat 的資料集 [2],其中每段對話都包含了對談話雙方的 natural text 形式的描述。在 NeurIPS 2018 上還進一步擴充並完善了資料集作為 shared competition task。

更近的時候,ParlAI 還釋出了和 CV 結合的 personalized image chat 資料集 [3]。此外,除了以上基於 chitchat 的資料集,ParlAI 也收錄 personalized bAbI dialog 這一個性化 goal-oriented 資料集 [4]。

Learning Personalized End-to-End Goal-Oriented Dialog

值得一提的是,以上這些個性化對話的研究都是基於 chitchat 的。而任務型對話,例如餐館預定服務、個人助理等,也同樣非常需要針對使用者進行個性化服務。這一方向的研究數量還較少,但具有很高的實用價值和繼續探索的空間,是非常適合繼續深入(& 發 paper)的藍海。

在本文的最後,簡略介紹一篇即將於本週四(2019.1.31)在 AAAI-19 上 presenting 的文章,有關任務型對話的個性化:

https://www.luolc.com/publications/personalized-goal-oriented-dialog/

上方連結的文章 website 中還較為詳細的概況了最近一段時間有關 Personalization 的其他相關進展,比本文所述更為詳盡,可以先閱讀瞭解。

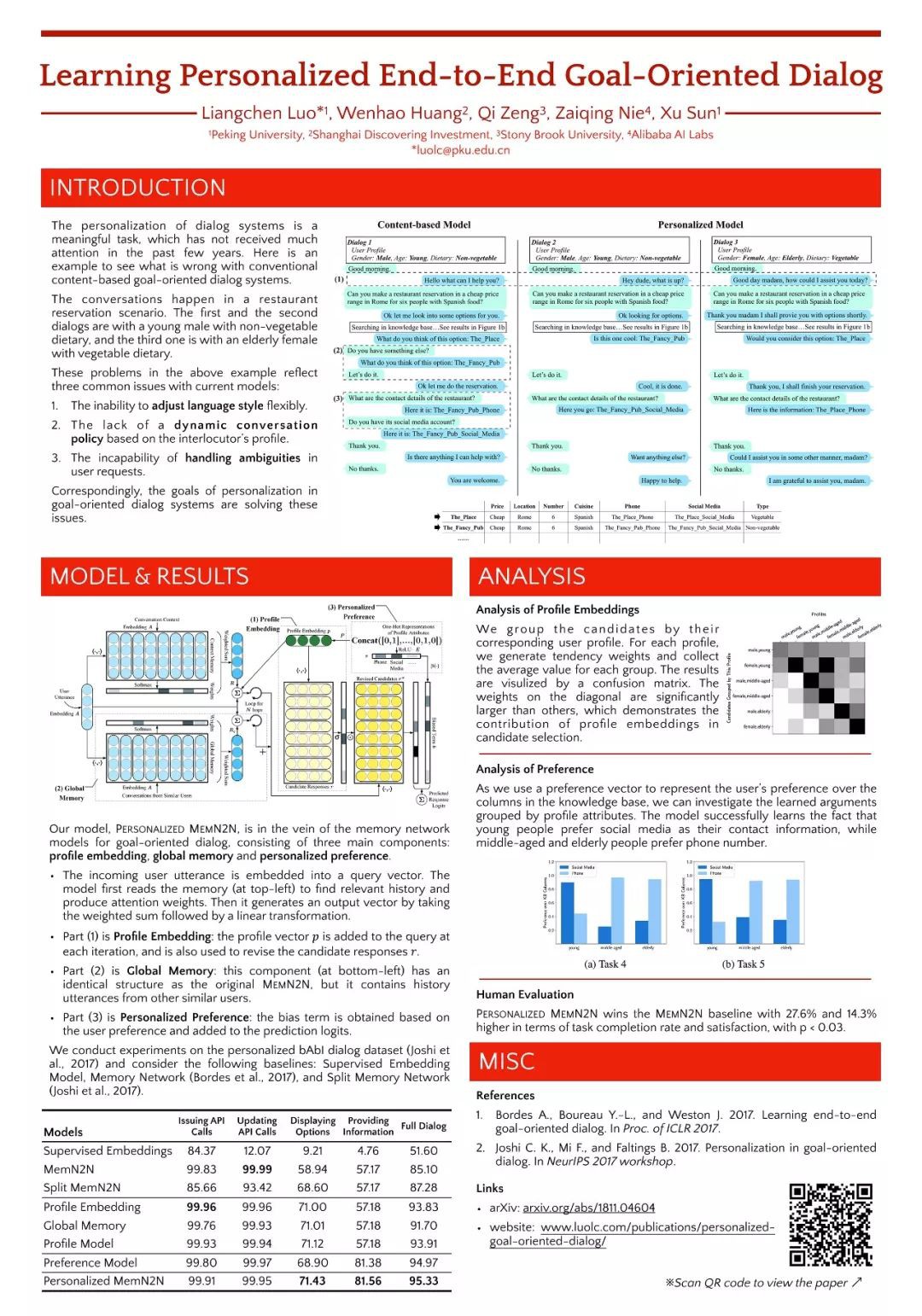

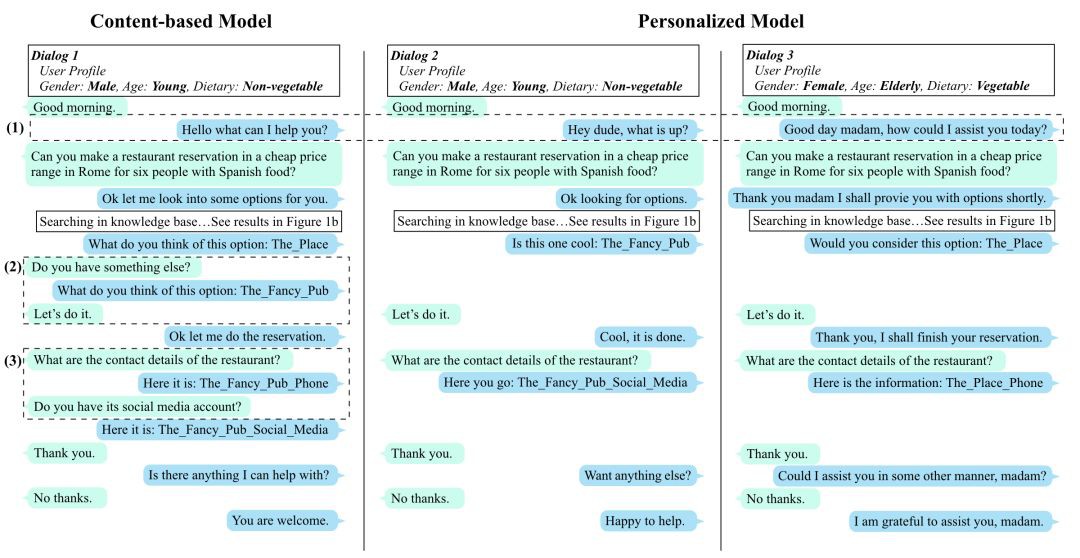

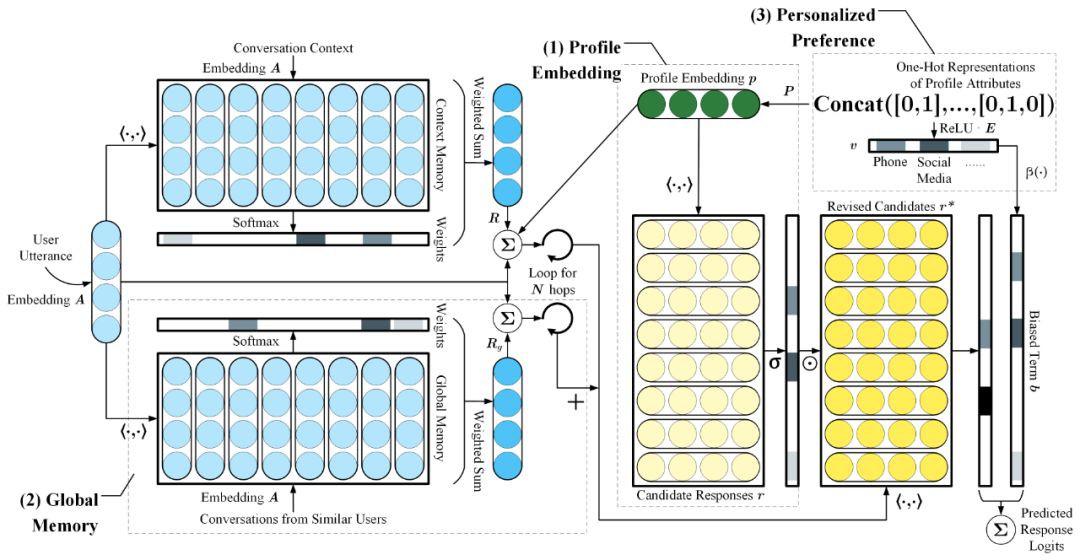

▲ Figure 1(a): Three example dialogs are chosen from the personalized bAbI dialog dataset. Personalized and content-based responses are generated by the Personalized MemN2N and a standard memory network, respectively.

▲ Figure 1(b): Examples of valid candidates from a knowledge base that match the user request.

我們從一個例子出發,直觀感受一下 conventional model 在不考慮個性化的情況下有什麼不足。

圖中的對話發生在餐館預定的場景中。Dialogue agent 需要根據使用者的請求推薦餐館,併在必要的時候提供額外資訊。在三組對話中,使用者輸入的請求都是完全相同的。前兩組對話的使用者是一位年輕男性,非素食偏好;第三組對話的使用者是一位年長女性,素食偏好。Figure 1(b) 是 KB 中檢索到的滿足使用者要求的兩個餐館。

可以觀察到:

1. 傳統模型的回覆是樸素和無趣的,且無法像個性化模型一樣根據使用者身份調整語氣和稱呼;

2. 在推薦餐館階段,傳統模型只能按隨機順序給出推薦 (即無法判斷兩個可能的選擇中哪個更可能受顧客青睞),而個性化模型則可以動態的調整推薦策略,在上例中,即是正確的考慮到了使用者是否有素食偏好;

3. 最後,註意到使用者請求中的「contact」既可以被解讀成 KB 中的「phone」也可以被解讀為「social media」。個性化模型在訓練中可以學習到年輕人傾向社交媒體賬號而年長者傾向電話號碼這一事實,從而解決歧義而給出使用者更期望的資訊。

這些現象反映了目前模型中對應的三個問題:

-

無法靈活調整語言風格 [5]

-

缺少根據使用者資訊動態調整對話策略的能力 [4]

-

難以處理使用者請求中的歧義項

而個性化任務型對話系統的標的便是解決上述問題。需要註意的是,在任務型對話中的個性化與 chitchat 有顯著不同。區別於給 Agent 賦予一個 consistent 的個性,任務型對話中的個性化要更多的聚焦在使用者的個性並需要 Agent 擁有對不同對話者進行調整從而提升對話效率和使用者滿意度的能力。

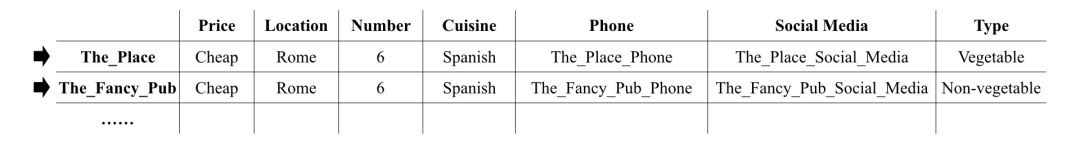

▲ Figure 2: Personalized MemN2N architecture.

文章提出的模型 Personalized MemN2N 基於適用任務型對話的經典模型 End-to-End Memory Network,包含三個主要部分:profile embedding、global memory、personalized preference。

使用者輸入會被 encode 為一個 query vector,模型會讀取 memory(左上部分)尋找相關的對話歷史並生成 attention weights,之後加權求和並做線性變換得到輸出 vector,這一部分即是原始的 MemN2N。

Profile Embedding

以 K-V 對錶示的使用者資訊在 One-Hot 編碼後經過一個可學習的引數矩陣變換為 profile embedding,在每一次 memory network 的迭代中加入到 query vector 中,並且用於修正 candidate pool 中的回覆(根據使用者身份直接過濾掉語氣不得體的一部分 candidates)。

Global Memory

這一部分(左下)和 MemN2N 的結構相同,區別在於 memory 中儲存的並非當前對話歷史,而是其他類似的使用者發生的其他對話的內容。這是基於類似的使用者可能具有對答案類似的傾向而設計的。

Personalized Preference

這一部分用於處理使用者請求的歧義部分,模型可以對 KB 中的每一列學習到一個 preference term,然後基於此對 logits 進行修正,以推薦使用者更偏好的資訊。

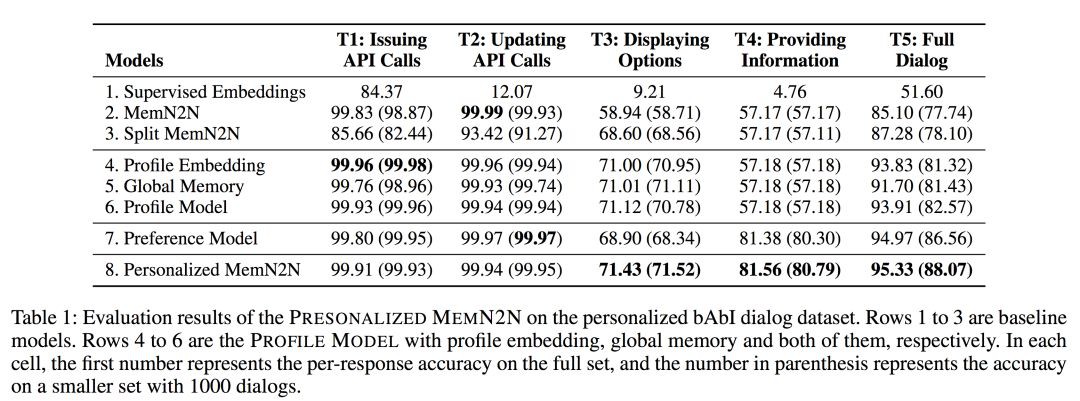

在任務型對話個性化資料集 personalized bAbI dialog 上,文章提出的模型在完整資料集上掃清了原先 state-of-the-art 模型超過 7 個百分點。

除此之外,文章進行了許多定量和定性分析,包括中間參量的視覺化,可解釋性討論和對照實驗等。同時,在人工評測中,新模型也在任務完成率和使用者滿意度兩項指標上獲得顯著提升。在此不做詳細闡述,具體細節可以瀏覽文章的 Analysis 章節。

總結

對話系統中的個性化無疑將成為新的一年裡最值得探索的方向之一,尤其是對於希望儘快發 paper 的同學,是非常不錯的一個新坑。而 Persona-Chat 和 Personalized MemN2N 則分別代表了 chitchat 和 goal-oriented 兩類 dialogue 任務中的最新 state-of-the-art,後者更是填補了任務型對話中的空白。如果希望做一些這方面新的工作,這兩篇文章是很重要的參考。

提前祝各位新春快樂!新的一年多發 paper 喲~ ^.^

參考文獻

[1] Jiwei Li, Michel Galley, Chris Brockett, Georgios P. Spithourakis, Jianfeng Gao, Bill Dolan. A Persona-Based Neural Conversation Model. ACL 2016.

[2] Saizheng Zhang, Emily Dinan, Jack Urbanek, Arthur Szlam, Douwe Kiela, Jason Weston. Personalizing Dialogue Agents: I have a dog, do you have pets too?. ACL 2018.

[3] Kurt Shuster, Samuel Humeau, Antoine Bordes, Jason Weston. Engaging Image Chat: Modeling Personality in Grounded Dialogue. arXiv:1811.00945, 2018.

[4] Chaitanya K. Joshi, Fei Mi, Boi Faltings. Personalization in Goal-Oriented Dialog. NIPS 2017.

[5] Jonathan Herzig, Michal Shmueli-Scheuer, Tommy Sandbank and David Konopnicki. Neural Response Generation for Customer Service based on Personality Traits. INLG 2017.

知識星球

知識星球