https://www.melvinvivas.com/developing-microservices-using-kafka-and-mongodb/

作者 | Melvin Vivas

譯者 | qhwdw ?共計翻譯:145 篇 貢獻時間:287 天

在我前面的部落格文章 “我的第一個 Go 微服務:使用 MongoDB 和 Docker 多階段構建[1]” 中,我建立了一個 Go 微服務示例,它釋出一個 REST 式的 http 端點,並將從 HTTP POST 中接收到的資料儲存到 MongoDB 資料庫。

在這個示例中,我將資料的儲存和 MongoDB 分離,並建立另一個微服務去處理它。我還添加了 Kafka 為訊息層服務,這樣微服務就可以非同步處理它自己關心的東西了。

如果你有時間去看,我將這個部落格文章的整個過程錄製到 這個影片中了[2] 🙂

下麵是這個使用了兩個微服務的簡單的非同步處理示例的上層架構圖。

rest-kafka-mongo-microservice-draw-io

微服務 1 —— 是一個 REST 式微服務,它從一個 /POST http 呼叫中接收資料。接收到請求之後,它從 http 請求中檢索資料,並將它儲存到 Kafka。儲存之後,它透過 /POST 傳送相同的資料去響應呼叫者。

微服務 2 —— 是一個訂閱了 Kafka 中的一個主題的微服務,微服務 1 的資料儲存在該主題。一旦訊息被微服務消費之後,它接著儲存資料到 MongoDB 中。

在你繼續之前,我們需要能夠去執行這些微服務的幾件東西:

我們開始吧!

首先,啟動 Kafka,在你執行 Kafka 伺服器之前,你需要執行 Zookeeper。下麵是示例:

$ cd /<download path>/kafka_2.11-1.1.0

$ bin/zookeeper-server-start.sh config/zookeeper.properties

接著執行 Kafka —— 我使用 9092 埠連線到 Kafka。如果你需要改變埠,只需要在 config/server.properties 中配置即可。如果你像我一樣是個新手,我建議你現在還是使用預設埠。

$ bin/kafka-server-start.sh config/server.properties

Kafka 跑起來之後,我們需要 MongoDB。它很簡單,只需要使用這個 docker-compose.yml 即可。

version: '3'

services:

mongodb:

image: mongo

ports:

- "27017:27017"

volumes:

- "mongodata:/data/db"

networks:

- network1

volumes:

mongodata:

networks:

network1:

使用 Docker Compose 去執行 MongoDB docker 容器。

docker-compose up

這裡是微服務 1 的相關程式碼。我只是修改了我前面的示例去儲存到 Kafka 而不是 MongoDB:

rest-to-kafka/rest-kafka-sample.go[5]

func jobsPostHandler(w http.ResponseWriter, r *http.Request) {

//Retrieve body from http request

b, err := ioutil.ReadAll(r.Body)

defer r.Body.Close()

if err != nil {

panic(err)

}

//Save data into Job struct

var _job Job

err = json.Unmarshal(b, &_job)

if err != nil {

http.Error(w, err.Error(), 500)

return

}

saveJobToKafka(_job)

//Convert job struct into json

jsonString, err := json.Marshal(_job)

if err != nil {

http.Error(w, err.Error(), 500)

return

}

//Set content-type http essay-header

w.Header().Set("content-type", "application/json")

//Send back data as response

w.Write(jsonString)

}

func saveJobToKafka(job Job) {

fmt.Println("save to kafka")

jsonString, err := json.Marshal(job)

jobString := string(jsonString)

fmt.Print(jobString)

p, err := kafka.NewProducer(&kafka.ConfigMap{"bootstrap.servers": "localhost:9092"})

if err != nil {

panic(err)

}

// Produce messages to topic (asynchronously)

topic := "jobs-topic1"

for _, word := range []string{string(jobString)} {

p.Produce(&kafka.Message{

TopicPartition: kafka.TopicPartition{Topic: &topic, Partition: kafka.PartitionAny},

Value: []byte(word),

}, nil)

}

}

這裡是微服務 2 的程式碼。在這個程式碼中最重要的東西是從 Kafka 中消費資料,儲存部分我已經在前面的部落格文章中討論過了。這裡程式碼的重點部分是從 Kafka 中消費資料:

kafka-to-mongo/kafka-mongo-sample.go[6]

func main() {

//Create MongoDB session

session := initialiseMongo()

mongoStore.session = session

receiveFromKafka()

}

func receiveFromKafka() {

fmt.Println("Start receiving from Kafka")

c, err := kafka.NewConsumer(&kafka.ConfigMap{

"bootstrap.servers": "localhost:9092",

"group.id": "group-id-1",

"auto.offset.reset": "earliest",

})

if err != nil {

panic(err)

}

c.SubscribeTopics([]string{"jobs-topic1"}, nil)

for {

msg, err := c.ReadMessage(-1)

if err == nil {

fmt.Printf("Received from Kafka %s: %s\n", msg.TopicPartition, string(msg.Value))

job := string(msg.Value)

saveJobToMongo(job)

} else {

fmt.Printf("Consumer error: %v (%v)\n", err, msg)

break

}

}

c.Close()

}

func saveJobToMongo(jobString string) {

fmt.Println("Save to MongoDB")

col := mongoStore.session.DB(database).C(collection)

//Save data into Job struct

var _job Job

b := []byte(jobString)

err := json.Unmarshal(b, &_job)

if err != nil {

panic(err)

}

//Insert job into MongoDB

errMongo := col.Insert(_job)

if errMongo != nil {

panic(errMongo)

}

fmt.Printf("Saved to MongoDB : %s", jobString)

}

我們來演示一下,執行微服務 1。確保 Kafka 已經運行了。

$ go run rest-kafka-sample.go

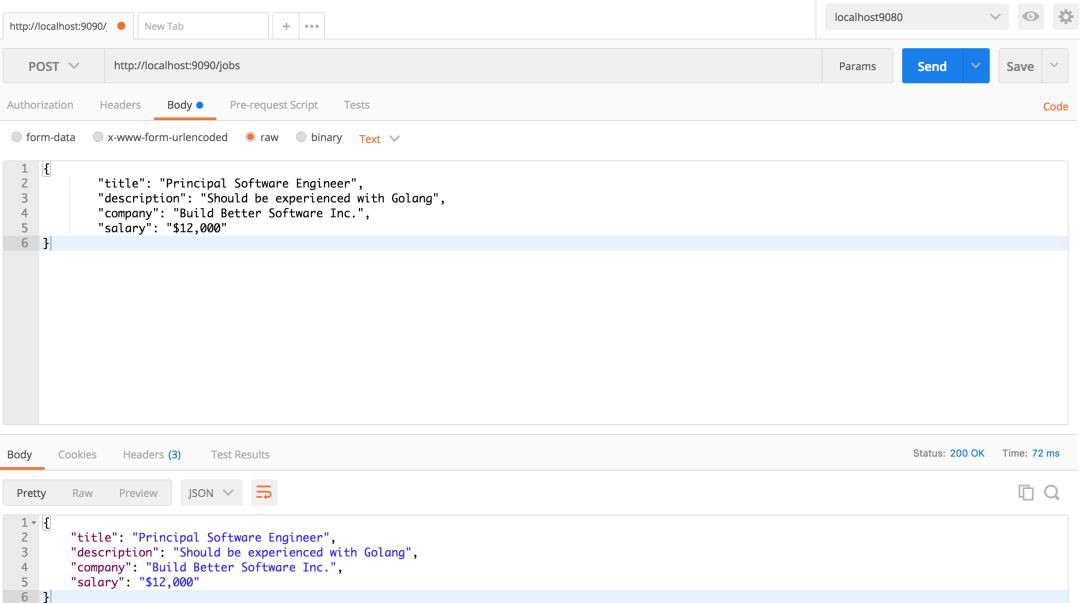

我使用 Postman 向微服務 1 傳送資料。

Screenshot-2018-04-29-22.20.33

這裡是日誌,你可以在微服務 1 中看到。當你看到這些的時候,說明已經接收到了來自 Postman 傳送的資料,並且已經儲存到了 Kafka。

Screenshot-2018-04-29-22.22.00

因為我們尚未執行微服務 2,資料被微服務 1 只儲存在了 Kafka。我們來消費它並透過執行的微服務 2 來將它儲存到 MongoDB。

$ go run kafka-mongo-sample.go

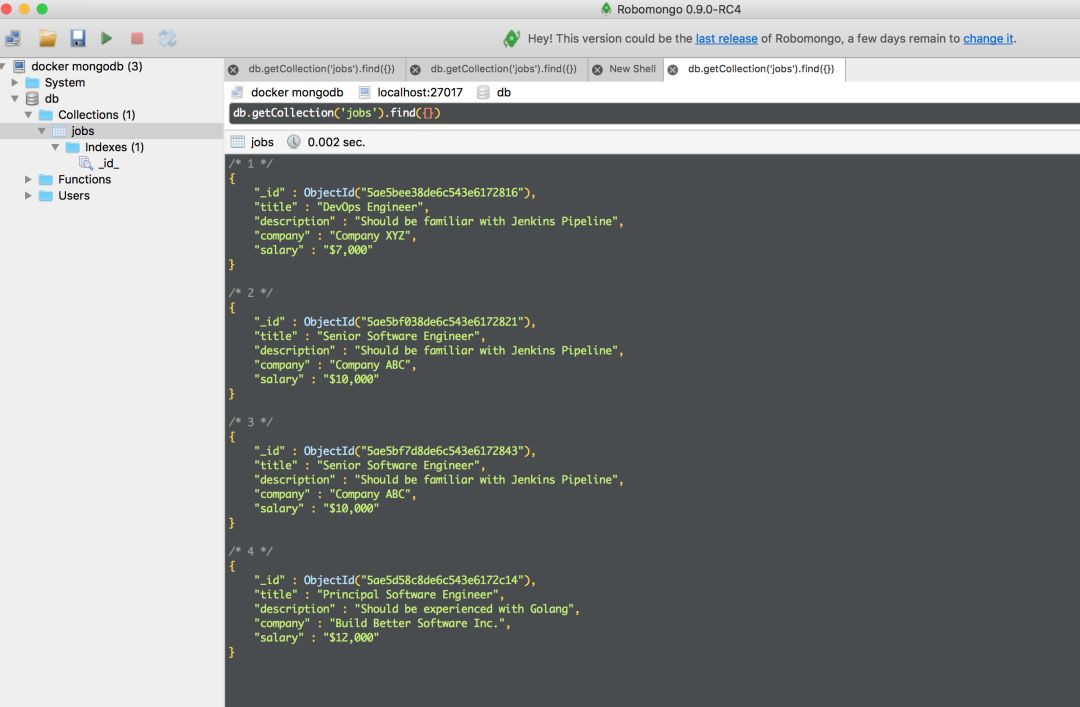

現在,你將在微服務 2 上看到消費的資料,並將它儲存到了 MongoDB。

Screenshot-2018-04-29-22.24.15

檢查一下資料是否儲存到了 MongoDB。如果有資料,我們成功了!

Screenshot-2018-04-29-22.26.39

完整的原始碼可以在這裡找到:

https://github.com/donvito/learngo/tree/master/rest-kafka-mongo-microservice

現在是廣告時間:如果你喜歡這篇文章,請在 Twitter @donvito[8] 上關註我。我的 Twitter 上有關於 Docker、Kubernetes、GoLang、Cloud、DevOps、Agile 和 Startups 的內容。歡迎你們在 GitHub 和 LinkedIn[10] 關註我。

開心地玩吧!

via: https://www.melvinvivas.com/developing-microservices-using-kafka-and-mongodb/

作者:Melvin Vivas [12] 譯者:qhwdw 校對:wxy

本文由 LCTT 原創編譯,Linux中國 榮譽推出

知識星球

知識星球