在碎片化閱讀充斥眼球的時代,越來越少的人會去關註每篇論文背後的探索和思考。

在這個欄目裡,你會快速 get 每篇精選論文的亮點和痛點,時刻緊跟 AI 前沿成果。

點選本文底部的「閱讀原文」即刻加入社群,檢視更多最新論文推薦。

本期推薦的論文筆記來自 PaperWeekly 社群使用者 @TwistedW。跨模態的影象生成在模態差異大的情況下是很難實現的,本文將一個模態下編碼得到的潛在變數當做條件經過 GAN 對映為另一個模態下的潛在變數,實現了模態間潛在變數之間的相互對映,從而實現了跨模態下的相互生成。

如果你對本文工作感興趣,點選底部閱讀原文即可檢視原論文。

關於作者:武廣,合肥工業大學碩士生,研究方向為影象生成。

■ 論文 | Cross Domain Image Generation through Latent Space Exploration with Adversarial Loss

■ 連結 | https://www.paperweekly.site/papers/2223

■ 作者 | Yingjing Lu

跨模態之間轉換生成在模態間差異大的時候是相對困難的,將一個模態編碼得到的潛在變數作為條件,在 GAN 的訓練下對映到另一個模態的潛在變數是本文的核心。雖然這篇論文只是預印版,但是文章的這個跨模態潛在變數相互對映的思想是很有啟發性的。

論文引入

人類很容易學會將一個領域的知識轉移到另一個領域,人類可以靈活地學習將他們已經在不同領域學到的知識連線在一起,這樣在一個領域內的條件下,他們就可以回憶或啟用他們從另一個領域學到的知識。

深度生成模型透過將它們對映到潛在空間來編碼一個域內的隱式知識是被廣泛使用的,可以控制潛在變數透過條件在學習域內生成特定樣本。然而,與人類相比,深層生成模型在從一個域到另一個域之間建立新連線方面不夠靈活。換句話說,一旦它學會了從一組域條件生成樣本,使其用於生成以另一組控製為條件的樣本通常很難並且可能需要重新訓練模型。

跨域轉換對於建立模態之間的聯絡是重要的,能夠讓神經網路更加地智慧化,有一些方法提出來解決跨模態的問題。將條件編碼對映到無條件訓練的 VAE [1],以允許它用使用者定義的域有條件地生成樣本,並取得了很好的效果。

但是一個限制是那些條件是透過 one-hot 專門定義的。這樣做需要特徵工程,並且想要對一些隱含的特徵進行條件化時效果較差,例如使用來自一個場景的影象作為條件來生成學習域中的相關影象。在 Unsupervised Cross-domain Image Generation [2] 中訓練端到端模型,假設這兩個域相關性,再迴圈訓練。

今天要說的這篇論文,在更少的模態假設下實現了跨模態的相互生成。總結一下這篇論文的優勢:

-

利用 GAN 實現了跨模態的潛在變數之間的相互對映

-

在較少的假設下實現跨模態的轉換

實現方法

我們一起來看一下文章實現的模型框架:

下標為 1 的代表著是模態 1 下的資料變換,相對應的下表為 2 的代表著模態 2 下的資料變換,上標代表著模態下的類別,i 類和 j 類。f 代表著編碼器網路,g 代表著解碼器網路,G 代表了實現對映的生成器,D 代表了對應的判別器,噪聲 ϵ∼N(0,1)。

我們看到上下兩路對應的是 VAE 實現框架,也就是上路為模態 1 對應的 VAE1 是一個完整的流程,下路為模態 2 對應的 VAE2 也是一個完整的流程,當訓練 VAE1 和 VAE2 到收斂狀態時(訓練完成),此時的編碼器已經可以很好的將模態資料編碼到隱藏空間了。

我們分析由模態 1 到模態 2 的變換。模態 1 的第 i 類影象![]() 作為輸入到模態 1 的編碼器

作為輸入到模態 1 的編碼器 從而得到 i 類的潛在變數

從而得到 i 類的潛在變數![]() ,將

,將![]() 作為條件,ϵ 作為噪聲輸入到生成器 G1 下從而實現對映到,模態2第j類的影象經過編碼得到的潛在空間下,此時由生成器 G1 得到的對映記為

作為條件,ϵ 作為噪聲輸入到生成器 G1 下從而實現對映到,模態2第j類的影象經過編碼得到的潛在空間下,此時由生成器 G1 得到的對映記為 。

。

判別器 D2 的目的是為了判別真實模態 2 下 j 類影象編碼得到的 和生成的

和生成的 是否是匹配,如果不匹配就認為是假,如果匹配了那就說明生成器 G1 成功欺騙了判別器 D2 從而實現相互博弈共同提高。相對應的,由模態 2 也可以向模態 1 對映,這個過程和模態 1 到模態 2 是相似的。

是否是匹配,如果不匹配就認為是假,如果匹配了那就說明生成器 G1 成功欺騙了判別器 D2 從而實現相互博弈共同提高。相對應的,由模態 2 也可以向模態 1 對映,這個過程和模態 1 到模態 2 是相似的。

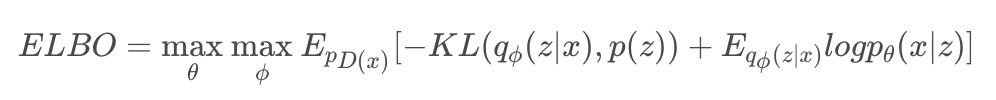

分析了框架的實現方法我們再看一下實現的損失函式上的設計,首先是 VAE 對應的損失最佳化,這個大家估計也都熟悉了:

ELBO 下引數的定義和原始 VAE 下是相同的,我就不重覆描述了,為了達到更好的 VAE 結果,文章還加了一個畫素上的重構誤差,所以最終 VAE 下的損失函式為:

這裡的 C 就是畫素上的重構誤差,λ1,λ2 為控制的引數,這個損失將實現 VAE 的整體最佳化。

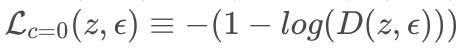

對於對映上的 GAN 的損失函式設計,文章主要採用匹配的方法博弈,文章匹配有三組。一組是真實匹配 z,z,對應的損失記為 ;一組是生成上的匹配 z,z′,其中 z′ 為生成的隱藏變數,對應的損失記為

;一組是生成上的匹配 z,z′,其中 z′ 為生成的隱藏變數,對應的損失記為 ;最後一組是噪聲對應的匹配 z,ϵ,對應的損失記為

;最後一組是噪聲對應的匹配 z,ϵ,對應的損失記為 。則最終的判別器的損失:

。則最終的判別器的損失:

在生成器中文章引入了正則項 ,當生成器將簡單噪聲移動到對映分佈時,通常會最大化所生成的輸出與原始噪聲 ϵ 之間的距離。隨著這個術語的增加,最小化損失函式以防 G 和 ϵ 太遠。綜合上述,對於 G 的損失函式可以寫為:

,當生成器將簡單噪聲移動到對映分佈時,通常會最大化所生成的輸出與原始噪聲 ϵ 之間的距離。隨著這個術語的增加,最小化損失函式以防 G 和 ϵ 太遠。綜合上述,對於 G 的損失函式可以寫為:

經過對上述損失函式最佳化,系統將達到平衡,此時就可以實現跨模態的相互生成。輸入模態 1 下的![]() 經過編碼得到

經過編碼得到![]() ,經過 GAN 的對映得到

,經過 GAN 的對映得到 送入到模態 2 的解碼器下得到輸出

送入到模態 2 的解碼器下得到輸出![]() ,從而實現了模態間的轉換。

,從而實現了模態間的轉換。

實驗

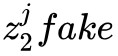

文中主要是在 MNIST 資料集和 SVHN 資料集下進行的實驗,MNIST→MNIST 的實現下的模態轉換主要是實現 0→5,1→6,2→7,3→8,4→9,其中 0,1,2,3,4 為模態 1 下的資料,5,6,7,8,9 為模態 2 下的資料,得到的生成的實驗結果如下:

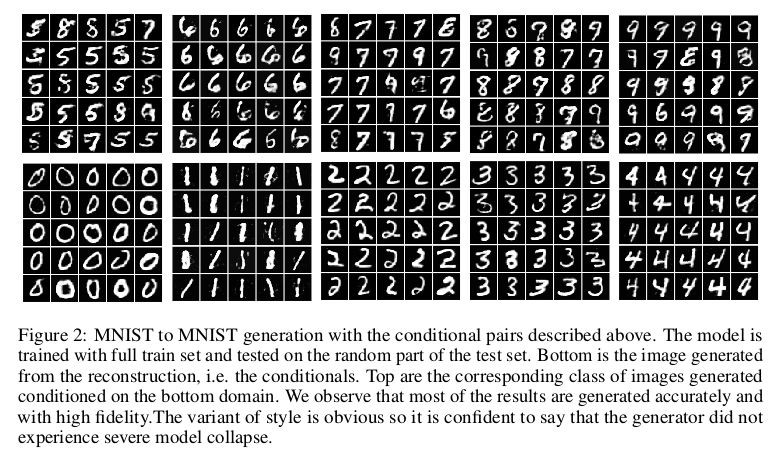

對於 SVHN 到 MNIST 的轉換,由於 SVHN 下沒有 0 這個數字,所以轉換為 1→6,2→7,3→8,4→9,結果如下:

在定量分析上,文中為生成的資料設計了分類器用來檢測生成資料的分類效果,側面反應生成的質量,同時也做了人體辨別實驗:

文中還補充了 MNIST 到 Fashion-MNIST 轉換的實驗,實驗生成上得到了不錯的效果:

由於只是預印版,所以一些詳細的對比實驗沒有加進去,不過這種方法的啟發意義還是蠻大的。

總結

文章利用 GAN 的思想在 VAE 的基礎上,實現了模態間的潛在空間的相互對映,得到對映的空間可以進一步的解碼生成對應於另一個模態的資料,從而實現了跨模態的相互生成。這種利用潛在空間的變換實現跨模態生成在很多跨模態之間都可以參考,雖然文章只是預印版但是很具有啟發意義。

參考文獻

[1]. Jesse Engel, Matthew Hoffman, and Adam Roberts. Latent constraints: Learning to generate conditionally from unconditional generative models. arXiv preprint arXiv:1711.05772, 2017.

[2]. Yaniv Taigman, Adam Polyak, and Lior Wolf. Unsupervised cross-domain image generation. arXiv preprint arXiv:1611.02200, 2016.

本文由 AI 學術社群 PaperWeekly 精選推薦,社群目前已改寫自然語言處理、計算機視覺、人工智慧、機器學習、資料挖掘和資訊檢索等研究方向,點選「閱讀原文」即刻加入社群!

點選標題檢視更多論文解讀:

#投 稿 通 道#

#投 稿 通 道#

讓你的論文被更多人看到

如何才能讓更多的優質內容以更短路徑到達讀者群體,縮短讀者尋找優質內容的成本呢? 答案就是:你不認識的人。

總有一些你不認識的人,知道你想知道的東西。PaperWeekly 或許可以成為一座橋梁,促使不同背景、不同方向的學者和學術靈感相互碰撞,迸發出更多的可能性。

PaperWeekly 鼓勵高校實驗室或個人,在我們的平臺上分享各類優質內容,可以是最新論文解讀,也可以是學習心得或技術乾貨。我們的目的只有一個,讓知識真正流動起來。

? 來稿標準:

• 稿件確系個人原創作品,來稿需註明作者個人資訊(姓名+學校/工作單位+學歷/職位+研究方向)

• 如果文章並非首發,請在投稿時提醒並附上所有已釋出連結

• PaperWeekly 預設每篇文章都是首發,均會新增“原創”標誌

? 投稿郵箱:

• 投稿郵箱:hr@paperweekly.site

• 所有文章配圖,請單獨在附件中傳送

• 請留下即時聯絡方式(微信或手機),以便我們在編輯釋出時和作者溝通

?

現在,在「知乎」也能找到我們了

進入知乎首頁搜尋「PaperWeekly」

點選「關註」訂閱我們的專欄吧

關於PaperWeekly

PaperWeekly 是一個推薦、解讀、討論、報道人工智慧前沿論文成果的學術平臺。如果你研究或從事 AI 領域,歡迎在公眾號後臺點選「交流群」,小助手將把你帶入 PaperWeekly 的交流群裡。

▽ 點選 | 閱讀原文 | 下載論文

知識星球

知識星球